Um Agente (AI)nda é da gente?

Se tem algo que a transformação digital vem nos mostrando é que, a cada avanço, nos aproximamos de experiências mais inteligentes, automatizadas e, ao mesmo tempo, menos visíveis. Mas será que estamos mesmo no controle?

Dias atrás, assisti a um vídeo do Atila Iamarino que me fez refletir bastante. Ele traz um ponto que merece atenção: saímos da economia da atenção e estamos entrando na economia da intenção, e isso, muda tudo.

Não estamos mais apenas sendo impactados por conteúdos que disputam nosso clique. Agora, a tecnologia tenta antecipar o que vamos desejar, consumir ou pensar, muitas vezes antes mesmo de termos consciência disso. Vamos combinar: a calibragem dos algoritmos em mecanismos de busca sempre foi um dilema, assim como aquele smartphone que parece "estar sempre nos ouvindo".

Seguindo nessa linha, os modelos de IA estão sendo treinados para prever nossos passos, preferências e até decisões. Parece útil, e muitas vezes é! Mas também pode ser perigoso, porque agora a IA não apenas nos observa, ela começa a agir por nós.

Os agentes de IA não servem apenas aos usuários. Muitas vezes (ou quase todas), também operam a favor dos interesses das big techs. Nesse cenário, os dados mais valiosos, as nossas intenções, viram combustível para modelos de negócio que escapam completamente do nosso controle.

Mais uma testa oleosa, se achando mente brilhante

Recentemente, o caso da startup britânica Builder.ai deu o que falar. A empresa, que havia captado mais de 445 milhões de dólares de investidores como a Microsoft, vendia uma plataforma “no-code” com uma assistente virtual chamada Natasha, que supostamente montava aplicativos como peças de Lego. Na prática, os pedidos dos clientes eram enviados para uma equipe na Índia, que desenvolvia o software manualmente, por trás da fachada de automação.

Além disso, a empresa se envolveu em um esquema contábil conhecido como "round-tripping", junto à startup indiana VerSe Innovation, trocando faturas de valores semelhantes para inflar receitas diante dos investidores. Um escândalo que, convenhamos, é tão interessante quanto certas polêmicas sobre babies reborn, pelo menos para mim. 😅

Esse caso serve como um alerta: Nem tudo que se divulga com IA é genial. É fundamental analisar com atenção e se precaver ao adotar soluções que prometem automação e inteligência artificial.

O papel da ALICE neste novo cenário

Na ALOT, quando

criamos a ALICE (ah, e sim, o nome vem de Alot Intelligence Conversational Experience),

tínhamos um objetivo claro: desenvolver um agente de IA que atuasse a favor das empresas e de seus clientes, sem depender apenas das grandes plataformas como intermediárias.

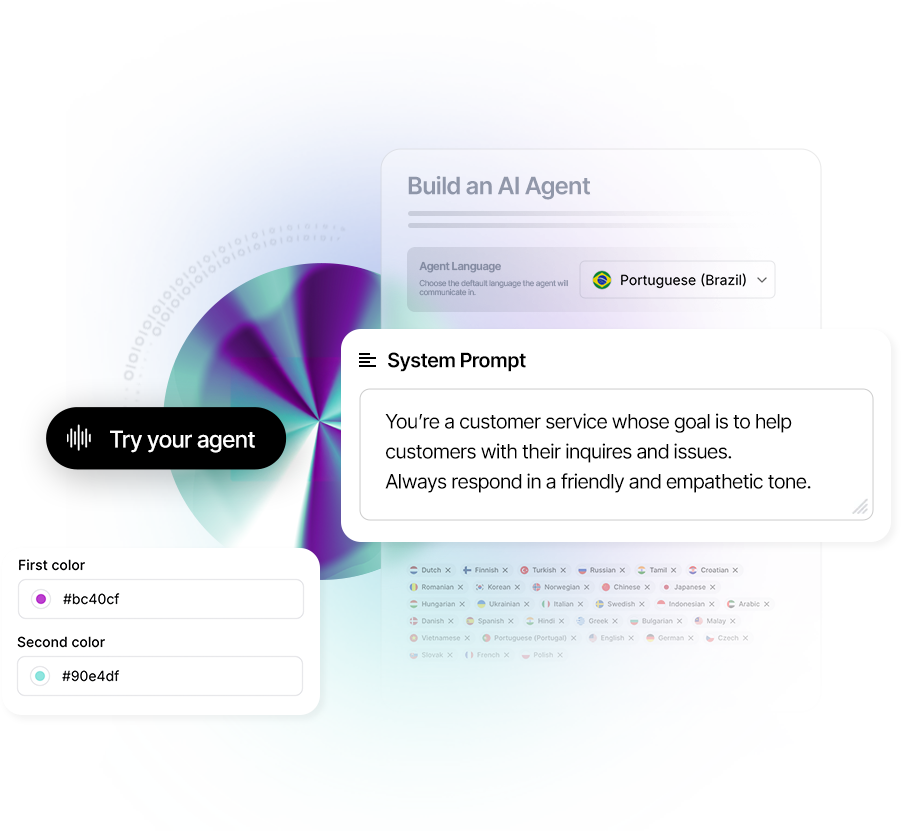

Ilustração sobre customização da ALICE com mais de 30 idiomas disponíveis.

Com esta nossa solução de IA conversacional, os dados podem permanecer com o cliente. A IA é treinada com segurança, alinhada aos objetivos reais do negócio. Dessa forma, permite preservar a privacidade e, ao mesmo tempo, usar a inteligência artificial de forma ética e estratégica, focada no que realmente gera valor.

Ou seja, é possível sim viabilizar um Agente de IA para entender e atender desejos de forma controlada, responsável e transparente.

Reflexões e mais polêmicas

Com cada vez mais modelos tentando prever nossas vontades, talvez seja hora de fazer uma pergunta simples: quem está por trás da tecnologia que você usa? A IA está te servindo ou te moldando?

O futuro já está sendo co-criado por todos nós, agora mesmo! E ele pode ser mais nosso do que imaginamos, desde que façamos as escolhas certas. O mais inteligente é garantir que ela, a tal da IA, esteja do nosso lado não é mesmo?

E sinceramente, hoje em dia, não sei se adianta ser gentil depois de uma resposta gerada por um prompt em um chat. 😛

Compartilhe com alguém nas opções abaixo